東北大学タフ・サイバーフィジカルAI研究センター

特任教授 田所諭氏

第1回

レスキューロボットの社会実装挑戦史

現状のAIに感じる違和感~フィジカルに根差したインテリジェンスとは

私はレスキュー・ロボットという、災害時に人命を救助したり、あるいは人の役に立つ活動をしたりするロボットの研究開発を続けてきました。神戸大工学部助教授だった1995年、阪神淡路大地震を経験し、壊滅状態に陥った神戸の街に立って、研究者として、災害救助で活躍するロボット、人命を救うロボッ トを作らねばならないと決意しました。以来、ロボットテクノロジーをレスキューに活用する研究に乗り出しました。

これをもう少し砕けたかたちで言います。ガンダムや鉄人28号のような正義の味方のロボットをつくりたかったのです。それが正直なところです。

インテリジェントに動くロボットを実現しようとしている立場から言うと、そのキーワードにAI(Artificial Intelligence)を挙げることには、大きな違和感を覚えています。

Artificial Intelligenceと言いながら、現存するロボットは、実はIntelligence in Artificially Structured Worldに過ぎないのです。要するに、人工的に作り上げられた環境の中で、それなりに気の利いたことを自動的にできる程度のレベルにしかない、というのが今のAIです。ディープ・ラーニングなどを用いて、フィジカルな世界とサイバーの世界がより密接に結びつくようになってはきましたが、これを実際に現場で使おうとした時には依然として厳しい部分が多い。もっと真剣にフィジカルに根差したインテリジェンスを考える必要があるんじゃないか、というのが私の主張です。

私が取り組んできたレスキュー・ロボットをご紹介した後、そこでの問題点や、それに対してインテリジェンスをどのように考えていったらいいのかを、ここで議論をしてみたいと思います。

災害時におけるロボットの役割とは

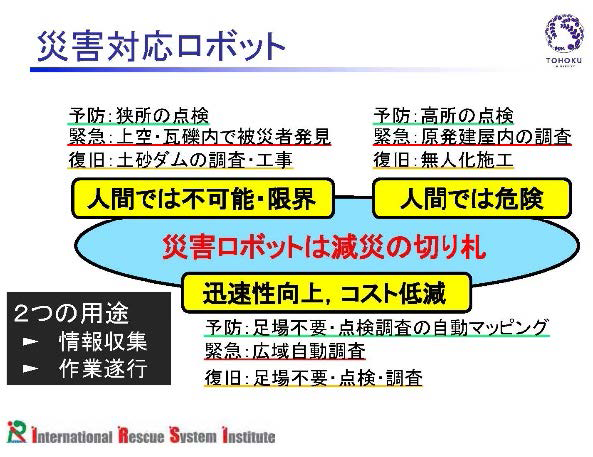

災害時におけるロボットの役割は以下のように整理されています。

「遠隔自律機能により、人間の仕事を代替することによって、困難な仕事を可能にする」

レスキュー・ロボットの役割には、災害の予防や緊急対応、災害の復旧などがあります。特に人間には対応が不可能であったり限界があったりする所、例えば狭い所を点検したり、あるいは上空や瓦礫内で被災者を発見したり、またあるいは土砂ダムなどの調査や工事を行ったりするというものになります。

ロボットの役割を災害救助という観点からもう少し詳しく考えてみる必要があります。

国連のOCHA(国連人道問題調整事務所 Office for Coordination of Humanitarian Affairs)という組織の中にUSAR(都市型捜索救助チーム Urban Search and Rescue)という組織があります。これは災害救助を行う人たちのグループで、このグループが主導する形で様々な救助活動の国際的な標準化や普及活動に取り組んでいます。このOCHAが2020年に、災害救助の捜索救助をどのように進めるかという国際標準ガイドラインを定めています。

以下のように、ASR(新アセスメント手法 Assessment, Search and Rescue)レベル1からレベル5の分類がなされています。

レベル1:広域の災害現場の評価

レベル2:作業現場のトリアージ評価

レベル3:迅速な捜索活動

レベル4:全面的な捜索救助

レベル5:全範囲をカバーする捜索と復旧

このように、レベルを5段階に分けて災害対応を進めていく手順が国際的な標準となっています。日本の災害対応は若干標準から外れた活動を行っているように見えるかもしれませんが、基本的にはこの標準に準拠しています。

このASRレベル1からレベル5で当面する災害救助のあり方を検討し、このレスキュー・ロボットはどこにどのように組み込まれて、どのように救援活動全体に貢献するべきかを明らかにしなければなりません。災害対応のレベルに応じてそれぞれの現場でのユーザーの要求に合ったソリューションをどのように提供していくのか。レスキュー・ロボットごとに役割が定義される必要があります。

レスキューロボットはSFの世界の話だと思われていた

私自身は、冒頭に述べました通り、阪神・淡路大震災でひどい目に遭い、災害現場で使えるロボットを造りたいと切に願い、レスキュー・ロボットを始めました。当時は世界中のどこを探しても、レスキュー・ロボットを本格的に研究している研究者はいませんでした。それはSFの世界の話だと思われていました。このままでは次の大震災が起こった時に人の命を助けられない、なんとかしなければならない。そういう想いを共有した有志が力を合わせて草の根から始めようと動き出したのです。

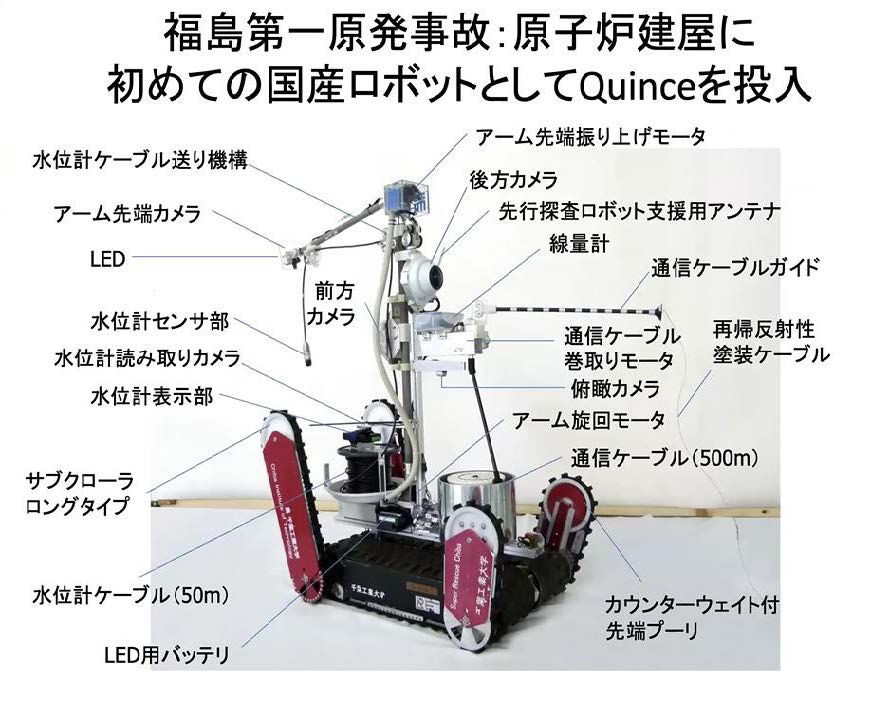

福島第一原発に初めて投入された国産ロボット“Quince”

2002年から文部科学省の大都市大地震軽減化特別プロジェクト(大大特)というプロジェクトを皮切りにして様々なレスキュー・ロボットの研究開発の旗を振る役割を果たしてきました。今振り返りますと、この大大特というプロジェクトがその後のレスキュー・ロボットの開発に与えた影響は非常に大きいと思います。

例えばQuince(クインス)のような福島原発で活躍したロボットの元をつくり、瓦礫内の捜索ロボットやドローンを研究して、ロボット防災の扉を開く役割を、22年前に行ったこの大大特プロジェクトが果たしたと考えています。

写真はQuince(クインス)というロボットです。多くの方がご存知かもしれませんが、福島第一原発事故で原子炉建屋内に初めて投入された国産ロボットです。

Quinceは、東北大学、千葉工業大学、国際レスキューシステム研究機構、その他幾つかの組織が共同で研究開発をしていました。このプロジェクトが終わる段階になって福島原発の事故が起きました。その当時、これ以外のソリューションが無いという状況の中で、このロボットを提供して何らかのお役に立つことができました。

私はそれまで原子炉を想定した研究をやったことがなかったので手探りにならざるを得なかったのですが、原子炉建屋内の厳しい環境の中で動き回って情報収集するというニーズに対して、線量マップをつくったり、ダストサンプリングをしたりして、このロボットがお役に立ててよかったと思っています。

その当時、日本のロボットはどうしたのかとお叱りを受けることにもなりました。しかしながら、日本では災害に対しての備えをしていなかったのだからそんなロボットがある筈もなく、私のような門外漢がしゃしゃり出てお役に立ったというのは、むしろ変な話だったなと思わざるをえません。

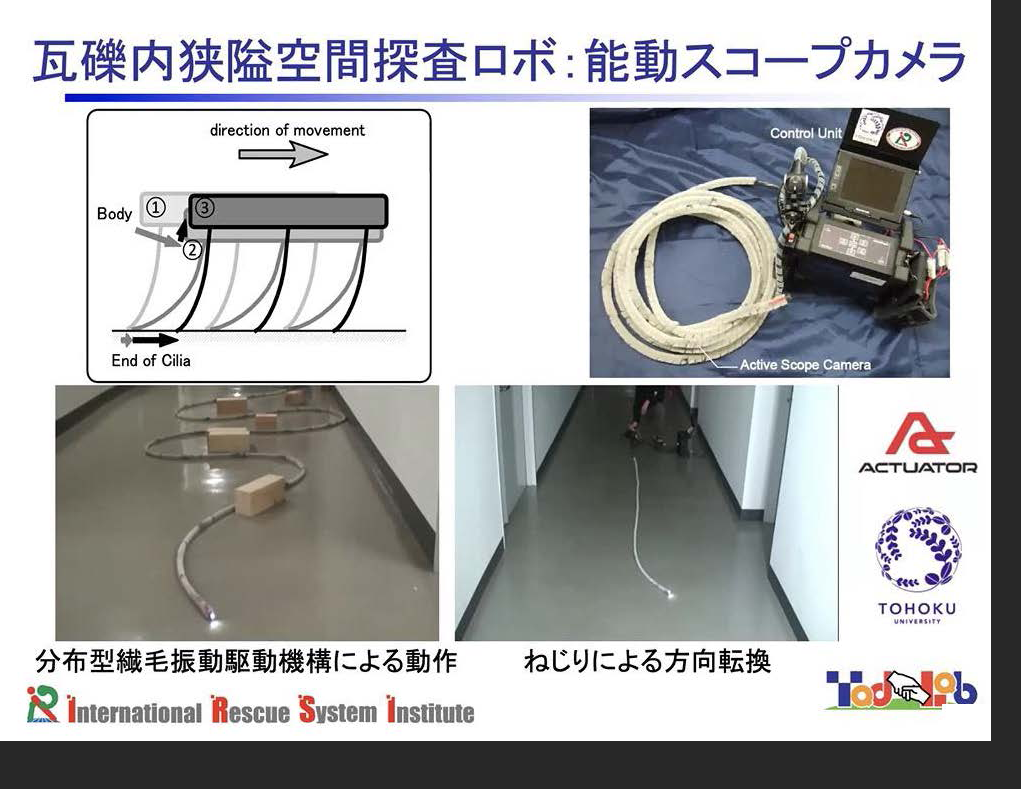

瓦礫の中を突き進む索状ロボット “能動スコープカメラ”

その後、2014年からImPACTタフ・ロボティクスチャレンジという内閣府のプロジェクトを主導しました。

そこでの主要な概念が、「タフ」です。

タフな技術をつくる。タフなロボットをつくることによって災害へのソリューションが得られる。そう考えて以下の5種類のロボットの研究開発を行いました。

- 飛行ロボット

- 脚ロボット

- 索状ロボット

- サイバー救助犬

- 建設ロボット

私はタフでへこたれないロボット技術をつくることで問題を解決したいのです。その挑戦の一つとして索状ロボットを開発しました。

索状ロボットとは、この写真のヘビのようなロボットのことで、能動スコープカメラと通称されます。ビデオスコープカメラのケーブルの周りにアクチュエーターがついていて、自走式で狭い場所に入っていくロボットです。今から20年ほど前に研究開発し、狭いところにどんどん入ってく技術をつくって製品化もされましたが、それほど売れた訳ではないようです。

具体的に災害現場に適用された事例ですが、駐車場建設現場の倒壊事故において、なぜ倒壊が起きたかという原因調査を行いました。調査担当者がロボットを操作して穴の中にカメラを入れて映像を撮って、事故の原因調査を行ったのです。

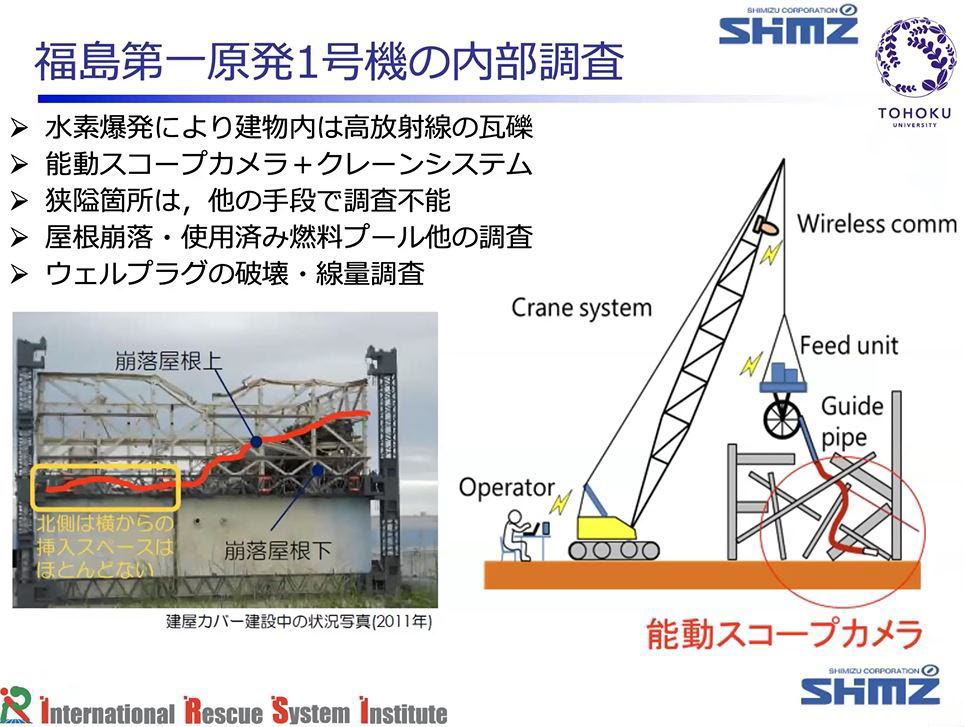

福島原発にも使われました。清水建設との協力で、クレーンで吊った能動スコープカメラを災害現場の中に入れたのです。

瓦礫下の屋根構造の状態把握が非常に重要でしたので、ボアホールを開けて、その中に能動スコープカメラを突っ込んで、中の映像を撮りました。また、ウェルプラグという構造がどれだけ壊れているかを調査する必要があり、その場所の線量調査を行いました。

このロボットは原子力発電所用ではなくて災害救助用として開発したものなのですが、実はこれまで災害救助に役立ったことはなく、役に立ち実績を上げるのはこのような調査ばかりででした。

空気と水を噴射させて“能動スコープカメラ”の運動能力を向上させる

ImPACTタフ・ロボティクスチャレンジでは、この能動スコープカメラの運動能力をもっと高めること、それから「見る・聞く・触れる」というセンシングの能力を向上させること、そのようなインテリジェンスの研究を行いました。中心となったのは私と東北大の昆明雅司先生です。

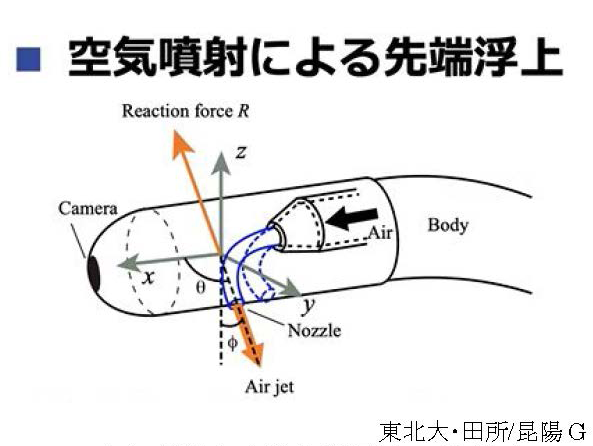

動く(=運動能力)という点では、図のように空気を噴射することによって蛇型のロボットが宙を浮いて瓦礫の中を動いていくという技術を開発しました。これまでの能動スコープカメラでは瓦礫のような場所では全く動くことができず手も足も出ないという状況だったのですが、この技術によって瓦礫の中をある程度動き回って中の映像を撮る等の作業が可能になりました。

この空気噴射によって得られたモビリティ機能を使って瓦礫の内部を調べる作業をやりました。当時の具体的なミッションは被災者の発見でした。

瓦礫の中の画像を自動認識して、中に何があるかをオペレータに対するガイダンスとして与えることによって、オペレータがより操縦しやすくなるシステムをつくりました。また、被災者を発見する大きな手がかりとなるのが音声なのですが、ノイズに掻き消されないように音声を聴き分けて、それを強調するようなシステムの開発に取り組みました。

瓦礫の中に能動スコープカメラを入れると、画像は撮影してくれるのですが、能動スコープがどこに入っていったのか分からない、その画像はどこを映しているのか分からない、つまり画像がどんどん送られてきても内部の状態がわからない、という問題が生じてきます。瓦礫内部の地図を作成しないといけないわけです。これをSLAMという技術を使って開発しました。SLAMは普通のオフィス空間用としては既に確立された地図づくりの技術ですが、こういった狭い空間ではうまくいきません。そこで高速のカメラを使うとか、フレームの選択を適応的にするとか、そういった技術を開発することによって狭いところでの地図づくりを可能にしました。

この能動スコープカメラは全身を振動させることができます。物に接触しますと振動の波形が変わりますので、それを活用することによって、どこが接触しているかを検出しようというのがこの研究の肝です。これにより、能動スコープカメラの接触状況をユーザーインターフェースで見ながら、カメラを遠隔操作していくということが可能になりました。

これらの研究成果を使って自動挿入システムを開発し、ロボットが自動的に瓦礫の中を調べる技術とシステムを研究しました。これはまさに索状ロボットの自律化、自動化、AI化の研究でありました。

しかし、実際に現場で使おうすると、こういった技術テンコ盛り製品は使い物にならないのです。従って、もっと簡便なものを目指しました。上図のような隊員の方が実際に現場に持って入れるものつくることを狙って機能をがっさり削ったものを開発しました。これらは実際に地震の際の建物調査に使われました。

この研究にとりかかる前、2016年に熊本地震が起こりました。その際に昔つくった能動スコープカメラを倒壊した建物の中に入れて内部調査をしたのですが、現場の大きな障害物を能動スコープカメラが乗り越えられず、中をくまなく見ることが難しかったのです。建築の専門家から受けたリクエストは、柱の下の構造物がどのように破壊されているか、ずれているか、そういったことを調べて欲しいということでした。しかし性能に限界がありました。それがその時の能動スコープカメラの実力でした。

2018年の西日本の土砂災害の時に、開発したモビリティ機能を初めて適用しました。土砂崩れにより倒壊した2階の木造家屋の中に空気を噴射する技術を使った能動スコープカメラを入れたのです。すると非常に奥深くまで挿入することができ、また、奥深くの映像を撮ることができて、これは役に立ちそうだということがわかりました。本事例は実際の救助案件でも災害調査でもなく、災害で倒壊した家屋を使って試験をさせてもらったものです。その後、実機を用いてユーザー試験等を行いました。

しかしそこにはまだあるべき水準との相当のギャップがあって、確かに昔のファイバースコープと比べると良くなっているのですが、「これではまだ機能が不足している」というのがその時のユーザーの声でした。ですからこれを製品化してもその製品を調達する段階までユーザーに進んでもらえるかというと、どうもそうではありませんでした。

そこで空気に代わって水を噴射する技術を開発しました。水を噴射すると空気噴射の場合よりも重たいものを空中に飛ばすことができます。その原理を使ってドラゴンファイヤーファイターという空飛ぶ消火ホースのロボットをつくりました。

上の写真はその実験の光景です。ホースが浮上して火元を直接消火できるロボットです。あまりホースが長いものをつくれなかったので後ろから人が押しています。このようにホースが空中に浮いて窓から中に侵入して火元を直接消火できる技術を開発しました。

火災の専門家たちといろいろお話をしたのですが、このレベルでは実際に使えるものにはならないという意見が大半でした。まだまだ開発すべき案件が残っている。それが正直な実感です。

救助犬をDX化する“サイバー救助犬スーツ”

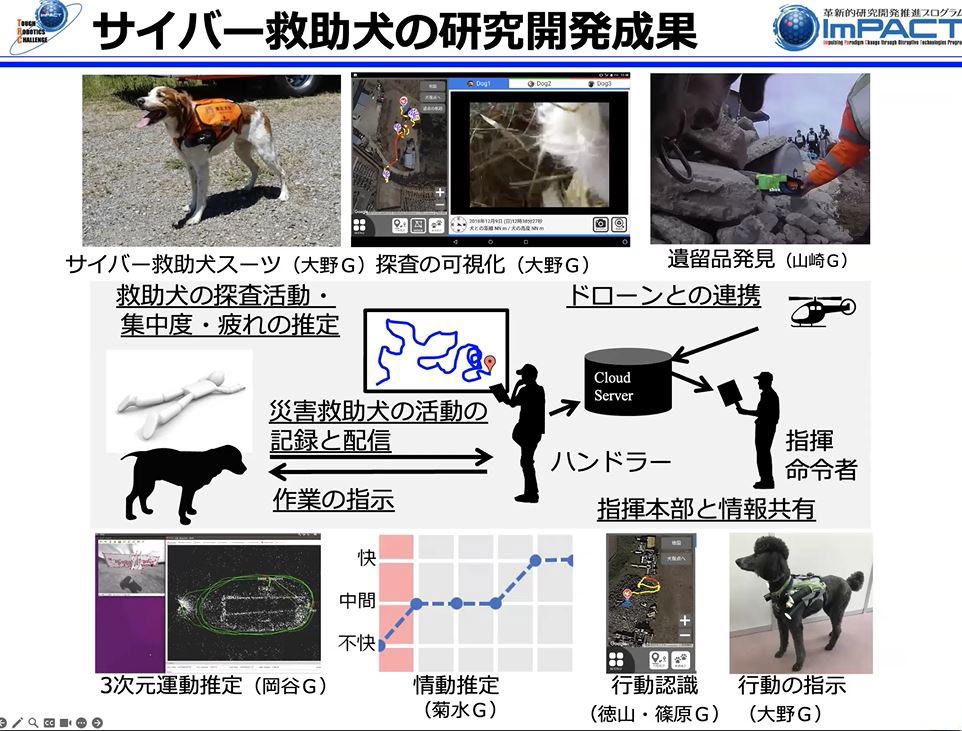

次に紹介するのはImPACTタフ・ロボティクスチャレンジで挑んだサイバー救助犬スーツの研究です。東北大学の大野和則先生が中心となって、日本救助犬協会と協力をしながら犬に着せるロボットスーツを開発しました。

災害現場において救助犬が活動して、要救助者を探し出すわけですが、これを高度化しようというものです。犬は動物なのでどうしても使いにくいところがありますが、サイバー救助犬スーツを着せることによってもっと使いやすいものにしていこうという研究です。

犬がどのくらい集中しているか、疲れているかを推定する。あるいは犬がどこに走っていったのか、なぜ吠えたのかを調べる。あるいは犬に対してどう行動指示するのか。そのような課題の研究を行いました。

犬が見た画像から遺留品を自動認識して、その映像をリモートで携帯電話に送ることによって判別可能にするという実証実験も行いました。

犬がどのように走っているか。どこで吠えたか。そういったことを地図上で全てモニタリングして、犬を有効活用する実験を行いました。これまではハンドラーと呼ばれる犬の飼い主(オペレータ)が犬に完全に寄り添っていないと捜索のミッションを果たすことができませんでした。しかし、このシステムにより、犬を数キロ先まで放って活動をすることができるようになりました。

また、犬による探査活動において、犬の活性度をリアルタイムにグラフで示すことができるようになりました。犬が要救助者を発見した際にエキサイトすると、このグラフでそれを読み取ることができます。こういったデータを頼りにして、犬をうまく操りながら動かしていくという技術をつくり上げていったのです。

さらに犬を誘導する実験を行いました。犬には光を追う性質があります。その性質を訓練した上で、犬を光で操縦して、右に行け、左に行けという指示を出し、所望の場所まで犬を誘導していくという技術の開発をしました。

災害現場におけるドローン活用方法

次はドローンの事例です。

ACSLと共にImPACTの研究に取り組みました。2017年に九州北部豪雨災害が起きました際に福岡県の東峰村の現地に災害出動し、ドローンを自律で飛ばして周辺の地図を作るという活動を行いました。

ドローンで2キロ余りの距離を往復してデータを取り、オルソ画像を作ることがでました。

このようなオルソ画像のデータが取れると、例えばストラクチャー・フロム・モーションという処理で、3次元の地図ができます。また、そこから瓦礫を抽出したり、瓦礫の体積を推定したりできます。そしてこの現場の復旧工事を行うためにどのくらいの土砂を運ばなければいけないかが分かります。そうするとどのようなダンプを何台手配すればよいか判断できます。

そういう意味で、こういった情報収集の手段が非常に有用であることが再認識されて、その後の消防庁のドローン調達等につながっていきました。

ただ、いざ現場に行くと問題山積です。捜索する現場の飛行ルートを指定しようとした時に、現場で携帯が通じなくて地図がダウンロードできなかったという体たらくもありました。地図の上で飛行ルートを指定しようとすると、結構手間がかかるのです。そんなに簡単にはいかない。高圧線、山の起伏、大きな木等いろいろな障害物があります。これらを全てクリアしないといけないのです。それに加えて、ドローンが目視外飛行となるので、有人ヘリとの干渉なども大きな問題となります。救助活動をしている有人ヘリとドローンが衝突してはいけないわけです。そういうことが原因となって、2024年1月に起こった能登半島地震ではドローンの飛行禁止のお達しが出たという話も聞いています。

このようにドローンを現場で使うのはなかなか難しいわけです。

多様な成果が上がりましたが、同時に課題も山積でした。その課題をよく見てみると、技術的な課題もありますが、技術的でない課題も沢山あります。技術的でない課題の中には、実はある技術を適用することで解決ができるものも沢山あります。現場にドローンを配備する場合には、これらを面的に解決しないといけないのです。しかし、ドローン・メーカーは良いドローンをつくることは頑張るのですが、なかなかこういった面的な課題解決が図れません。

そう考えると、ドローンそのものの開発だけではなく、ユーザーが求める機能を発揮できるようにドローン利用の周辺にある条件をきちんと面的に整備をしていく研究開発が重要であることがわかります。ロボット本体が技術的に問題であることも無きにしもあらずですが、そこを解決しただけでは問題は終わらないでしょう。災害救助の当事者にとってドローンもロボットもそのためのツールの一つにしか過ぎない。ですからシステム全体をどのように設計して、どのように整えるかを考えなければいけません。ロボットやドローンの実装が進まないのは、個々のロボットやドローンに問題があるということで片付けられてしまっているが、実はそうではありません。周辺環境を含めたシステム全体のコントロールこそが技術の本質であって、そこを解いていかないといけないのです。フィジカル・インテリジェンスとは、そういったところまで踏み込んで現場とロボットの頭の中とを橋渡しをしていく知能です。

新しいスタイルの社会インフラ “EAGLES Port”

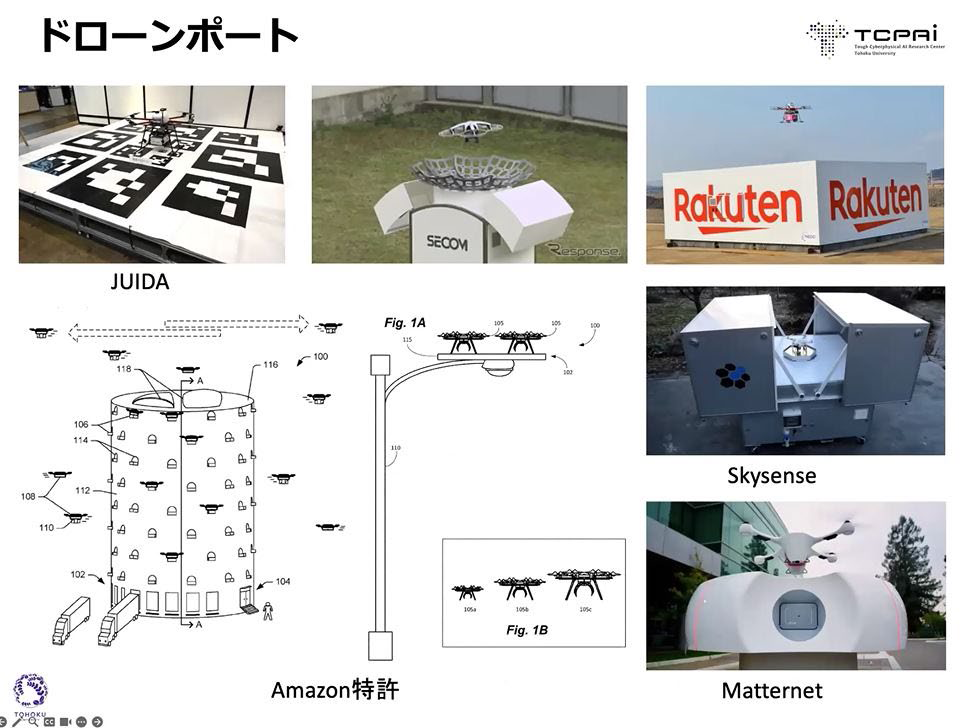

ドローンがフィジカル・インテリジェンスを実現するためのインフラとして新たなスタイルのドローンポートを開発しました。

ドローンポートはご承知の通り、上図のようにドローンが離陸着陸できるものです。

この左側のアマゾンの特許のような状態を実現しようとすると、著しく沢山の離発着ポートが必要になり、現実の運用上は大問題になります。

東京オリンピックの開会式で披露されたようなドローンショーをやることを想像してみてください。一千機のドローンを平地のグランドの上に並べておいて、それを一斉に飛ばさなければなりません。いったいどこの倉庫でそんなことができるのか。一千機をどうやって飛ばせばいいか.。そう考えるとお寒い感じがします。

そこで、EAGLES PORTという技術を開発しました。次頁をご覧ください。

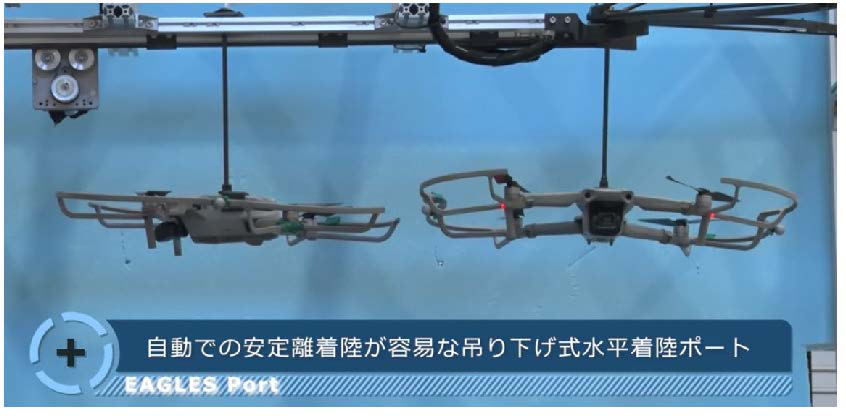

*次の写真は(https://youtu.be/juoE1EX16pQ?t=4)からの抜粋

EAGLES Portがもたらすドローンの社会実装の可能性の深化と拡大

先程、周辺環境を含めたシステム全体のコントロールこそが技術の本質だと申しましたがEAGLES Portはその思想に即したアプローチです。

EAGLES Portは写真でお分かりの通り、吊り下げ式の水平着陸ポートです。この技術はAIを搭載したドローン、つまり自律知能を有するドローンの社会実装を進める上で大きな役割を果たすはずです。EAGLES Portは、従来のドローンポートの弱点を克服した画期的な離着陸システムであるのですが、具体的には以下の特長を有しています。

特長1:高い安定性と耐風性能

従来方式のポート、垂直に着陸するため飛行安定マージンが低く、風の影響が大きく受ける。そのため着陸位置精度が低い。EAGLES Portは、安定マージンが高い水平飛行状態を保ったまま高速での着陸が可能になります。その結果、風にも強く、着陸の精度が高くなります。

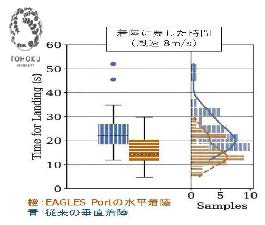

風速3メートルの場合、従来方式のポートでも着陸できましたが、EAGLES Portでは着陸が短時間で済みます。風速が6メートルの場合、EAGLES Portはやはり短時間で着陸しますが、従来方式ポートでは、着陸精度が不安定でかつ時間がかかります。風速を9メートルに上げて比較運転すると、EAGLES Portでは普通に着陸できましたが、従来方式のポートでは着陸が困難になりました。

特長2:水平飛行は軌道精度が高いので自動化が容易

従来方式では、オペレータが操縦して決められた水平面に着地させなければならなったためオペレータの操縦スキルによって飛行軌道や離着陸の精度が大きくバラつきました。なによりも一台のドローンにスキルを有する一人のオペレータを貼り付けるのですからドローンを活用すると高コストになります。これがドローン活用のボトルネックになってきました。

EAGLES Portを使うことによって水平飛行での離着陸ができるようになります。そして水平飛行は軌道精度が高いために自動化が可能になります。そうなるとドローン運用のコストが下がりボトルネックが解消に向かいます。

特長3:荷物の積み下ろしが容易

従来は平面上に着陸するため、運搬荷物の受け渡し、バッテリー交換、メインテナンスに手間がかかりました。吊り下げ方式によりドローンの下側が空くため、荷物の受け渡し、バッテリー交換、メインテナンスが容易になります。

特長4:複数ドローンが連続着陸できる

1カ所で多数機が着陸でき、かつ高速での連続着陸も可能になります。またEAGLES Portでは、航空機の滑走路と同じ方式で、着陸を誘導できます。

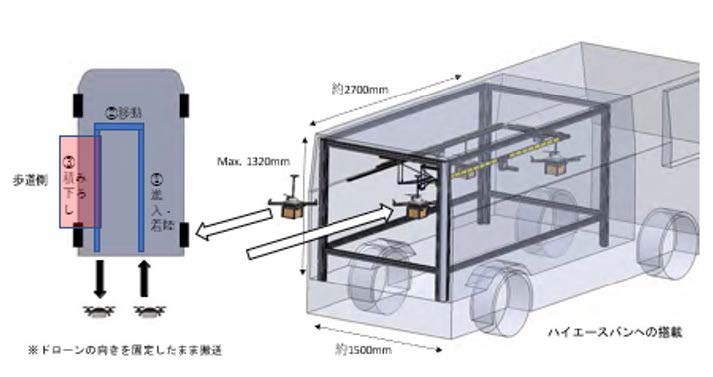

特長5:車に搭載して運搬できる

サイズはコンパクトにつくることができるのでワゴン車の荷台などに載せて運ぶことができます。これにより、現地到着後に、車両から直接離着陸できます。例えば山間部でドローンによる点検をする場合、人がアクセス困難な場所にドローンの離発着の基地を設けてやって自動で定期的に点検をすることが可能になります。基地を移動できることによりアクセス困難な場所でもドローンのオペレーションが容易になります。

特長6:1つのポートに様々な種類のドローンが離着陸可能

EAGLES Portには種類を問わず様々なドローンを離着陸させることができます。一つのEAGLES Portを設ければ、メーカーを問わず、様々ドローンが運用可能になります。

以上、EAGLES Portの特長を述べてきましたが、いくつか補足を述べます。

福島ロボットテストフィールドの風洞棟を使って強風下での着陸試験で極めて顕著な結果が出ました。着陸所用時間を35%短縮することができ、着陸位置の位置精度が大幅に向上したのです。1箇所に多数のドローンが連続着陸できることも実証されて、大きな有効性が示されました。

実は今回の実証実験では、ドローンをEAGLES PORTに手動で着陸をさせたので、オペレータがどのくらい慣れているかによってドローンの着陸の精度に大きな違いが出てしまいました。手動離着陸では、このEAGLES PORTの威力が必ずしも顕著に現れてこないのですが、自動離着陸を前提とすると、狭いところに自分でどんどん着陸をし、自分でどんどん離陸をしていくことが可能です。そういう意味でかなり筋が良い技術になるはずです。

EAGLES Portの意義1-フィジカル・インテリジェンスの実現

現在のAIを搭載したロボットは、結局のところ、人工的に作り上げられた空間の中でだけ自律機能を発揮できる水準にとどまります。物理的に困難な環境条件下では殆ど機能しないのです。そのブレークスルーをロボット単体に求めることには限界があります。困難な環境条件下でもそれに適応してタフに働くためにはどうすればいいか。人間を含む複数の知能体が相互に繋がって実現する集団知能、つまりフィジカル・インテリジェンスにその解があります。EAGLES Portは航空機の滑走路と同じ方式で着陸を誘導できる知能体であり、AIを搭載したドローンとつながりドローンと共に集団知能を形成します。

周辺環境を含めたシステム全体のコントロールこそが技術の本質であって、そこを解いていかないといけないのではないかと申し上げましたが、EAGLES Portが集団知能の一翼を担うことでフィジカル・インテリジェンスを実現し、周辺環境を含めたドローン運航システム全体へのコントロールを強めることができる。それがEAGLES Portの意義だと思います。

EAGLES Portの意義2-ロボット・コンシャスな社会づくり

EAGLES Portのもう一つの意義を語ります。それはロボットコンシャスな社会づくりへの寄与です。今後ますますロボットが人間と共生していく状況を考えた時に、AIを実装したロボットコンシャスな社会や産業基盤をつくっていく必要があります。

EAGLES Portが小型ドローンのための離発着ポートの共通方式となり、メーカーを問わず利用できるようになるとドローンの実用範囲が大きく拡がります。EAGLES Port自体もかなりの自由度で移動できますのでドローンが社会の隅々まで、あるいは険しい自然、気候条件の土地まで入り込むことができます。しかもドローンの自動化をはかることでその効率は飛躍的に向上します。

災害現場付近に車載EAGLES Portが到着。そこにメーカーが違う様々なドローンがどんどん集結して着陸。そして100台を超えるドローンが災害状況を把握するために一斉に飛び立つという光景を見る日が近いかもしれません。車載EAGLES Portがこのようなロボットコンシャスな社会基盤として実装されていくことで災害対策も進化します。EAGLES Portが離着陸ポートの世界共通のインフラとして活用されるのであれば世界は大きく変わるでしょう。

コンテストがロボットを発展させる-”WRS ワールド・ロボット・サミット”の開催

私たちはワールド・ロボット・サミットを開催してきました。OECDの閣僚理事会での安倍首相の発言がきっかけとなって始まったものです。ロボットのコンテストを活用することによってロボットの適用を広めることを意図しています。

ロボットのコンテストというとNHKの番組でやっているロボコンのイメージが大きくて、なんだロボコンかと思われがちなのですが、実のところこれがオープン・イノベーションのための方法論としてコンテストは極めて有効であることが世界的に知られています。

オープン・イノベーションの事例としてDARPA (米国防総省高等研究計画局)の主催によるグランド・チャレンジとアーバン・チャレンジがあります。前者は砂漠、後者は都市の中を自動走行する自動車のレースです。これをやることによって、技術的な開発もさることながら、多くの人々が自動走行を目の当たりにしてその可能性を信じるようになりました。これが大きいのです。

そういった意識改革を行うことによって、自動車の自動運転の道が開かれました。ここで意識改革した人的資源がベースとなって現在の自動運転の時代ができ上がってきたのです。Googleカーもこの流れの中で走り始めました。

また、ロボカップ・レスキューという競技会がベースとなって、先にご紹介しました原発で活躍したQuinceの基盤が出来ましたし、また、AUVSIという団体がやっているコンペティションがベースとなって、現在の自律ドローンの基盤が築かれてきました。

ロボカップのサッカーでは、当初はソニーのAIBOが使われていましたが、AIBOの販売終了があり、2007年に主催者はアルデバランというベンチャー企業からNaoというロボットを標準プラットフォームとして購入することを決めました。その結果として、アルデバランは自律機能を持つロボットの開発をどんどん進めることができるようになりました。その後、アルデバランはソフトバンクに買収されて、それが今のペッパーに繋がっていったのです。

そんなふうにして、コンテストは市場が未成熟の段階から意識改革を促し、人的基盤を形成し、新たな研究開発へと向かう潮流をつくり上げて、大きな実績を上げてきています。

ワールド・ロボット・サミットにおいてオープン・イノベーションを推進する場として、「プラント災害予防チャレンジ」という競技を実施してきました。

ワールド・ロボット・サミットは2018年にプレ大会を行い、2021年に本大会を行い、また、2025年には第2回のワールド・ロボット・サミットを実施します。

P1~P5までのタスクが設定されています。ロボットがそのタスクのクリアを競い合う競技です。

タスクP1: プラントの中の日常点検と設備の調整。配管に設置されているメーターを見ながらロボットがバルブの調整。

タスクP2: 異常検知と緊急対応。酸素濃度異常を示しているタンクの中にドローンがセンサー・プローブを挿入して、中の状態を測定。また、地上走行ロボットが設備にプローブを当てて、異音や振動を検知。

タスクP3: パイプ群とダクトの設備診断。ダクトのボルトの緩みや錆などを調査。

タスクP4: タンクの設備診断。タンクに貼ったクラックとか錆のサンプルプレートの検査。

タスクP5: 総合試験。今までのタスクの組み合わせと同時に、緊急事故が起きたという想定で救助を求めている人を捜索。小型ロボットが障害物のパイプをどけて、向こう側を捜索して、どこに人がいるかを調べる競技。

以上が2021年の内容ですが、2025年はこの競技を継続していこうと考えています。

主催が福島国際研究機構に変わりましたので災害時を念頭に困難な環境をメイン・ターゲットにして競技を実施します。ベースはプラントの点検や設備診断にありますが、それをより厳しい環境で実現できるようにしようというのが今回の目的です。P1からP6というミッションを掲げまして、緊急対応としてバルブの操作や事故の対応などを取り組もうということになっています。

今回の重要ポイントは、いかにして自律化を果たしていくかということです。自律とは、遠隔から何らかの方法で自動的にミッションが与えられて、そのミッションをクリアするためにロボットが自動的に何らかのタスクを行うはたらきです。また、ロボットが集めた情報が自動的に集約されて、それが災害の対応で、あるいはプラントのメインテナンスに活用され得ることも自律の重要な要件となります。

ロボット側とプラント運営側との間をデジタルツインとしてつなぎ、標準化された通信のミドルウェアを設けて、標準化されたプロトコルでロボットから集めた情報をデジタルツイン側に送って、デジタルツインで何が起きているかをモニタリングできるようにする。また、何をやってほしいかというロボットに対するリクエストをデジタルツインからミドルウェアを通じてロボット側へ送って、ロボットはそれに従ってミッションを果たす。今回の競技でロボットに要求されるのはそういうモデルなのです。

まだこのレベルではインテリジェントとは言えない水準ですが、こういったことを競技会としてやり続けてどんどんレベルを上げていくことによって大きなイノベーションにつなげていく。そしてそれをロボットの社会実装に繋げていくというのが、WRS-ワールド・ロボット・サミット-が展望している未来です。

第2回は「空間エージェント網が切り拓く未来」

8月20日掲載予定

出典:東北大学大学院工学研究科技術社会研究システム専攻/東北大学タフ・サイバーフィジカルAI研究センター(TCPAi)/株式会社現代経営技術研究所共同開催セミナー/第392回産業事情検討会(2024年6月18日開催)の田所諭氏報告からの再編集。

田所諭(たどころさとし)氏

東北大学タフ・サイバー・フィジカルAIセンター 特任教授。東北大学 大学院情報科学研究科 応用情報科学専攻 教授 東北大学タフ・サイバーフィジカルAI研究センター長を経て現職。1984年,東京大学工学系大学院修士課程修了。1993年,神戸大学助教授。2002年~,国際レスキューシステム研究機構会長。2005年~,東北大学教授。2014年,同副研究科長。2019年~,同タフ・サイバーフィジカルAI研究センター長。2014~18年,内閣府ImPACTタフ・ロボティクス・チャレンジプログラムマネージャー。2016~2017年,国際学会IEEE Robotics and Automation Society President。科学技術分野の文部科学大臣表彰科学技術賞他受賞。レスキューロボットの研究に従事。博士(工学).IEEE Fellow。